当运行下面代码时出现下面的错误

if iteration%10 == 0:

print("===> Epoch[{}]({}/{}): Loss: {:.10f}".format(epoch, iteration, len(training_data_loader), loss.data[0]))

修改建议:

去掉loss.data[0]后面的[0]。

if iteration%10 == 0:

print("===> Epoch[{}]({}/{}): Loss: {:.10f}".format(epoch, iteration, len(training_data_loader), loss.data))

原因:loss是0维张量

创建一个Tensor默认是不可导的,即 .requeires_grad 属性等于false。

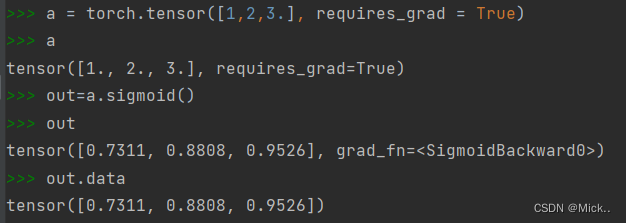

在pytorch0.4版本之后,Variable和Tensor进行的合并。loss.data直接输出tensor值,不输出tensor的梯度信息。比如:

loss是0维张量,因此在输出loss.data的时候维度为0,可以用loss.data.size()测试。可以利用loss.item()将张量转换为python number。

![]()

重点介绍一下.data和detach()函数的区别

推荐在经网络网训练或测试时访问tensor的数据时使用.detach()方法。

简单的说就是使用y=x.data属性来访问数据时,pytorch不会记录数据是否改变,此时改变了y的值,意味着也要改变x的值,而在自动求导时会使用更改后的值,这回导致错误求导结果。

而使用y=x.detach()时,如果了y值,也意味着改变了x值,此时调用x.backword()会报错。也就是说.detach()方法会记录数据的变化状态