问题描述:

深度学习的核心就是卷积,而卷积的核心那就是张量。

那么如何理解张量(tensor)就成了深度学习路途中不可缺少的一步,讲真的,刚学习深度学习那会儿张量实在是困惑了自己很长一段时间,而这篇文章根据自己学习深度学习的历程给出了一个清晰通俗的解释,相比于官方教材给出了更容易让初学者更能理解的逻辑举例。

如果你的张量理解程度还停留在只能想象出三维的张量维度的话,相信这篇文章一定能让你彻底理解各种维度的张量!

理解第一步:

对张量最初级的理解可以举例为python中的列表,这里的list就可以理解为一维张量:

list=[1,2,3,4,5]

我们也可以通过常见的张量生成函数torch.rand()来生成一位张量(torch.rand的作用通俗来说就是产生均匀分布的数据!

torch.rand()里面有几个数字那么就是生成几维张量!

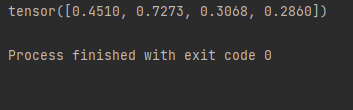

例如这里生成一维张量:

import torch

#生成一个有四个随机张量元素的一维张量

x = torch.rand(4)

print(x)

生成结果:

好了,到这你就完成了理解张量的第一步了!

矩阵,这是理解张量的第一步,

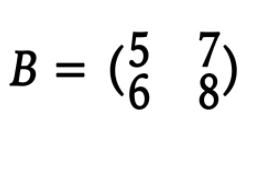

理解第二步(二维张量):

理解张量的第二步也不难,其实就可以理解为我们大学课程中学习的矩阵!

例如这个两行两列的矩阵B就可以看作一个二维张量:

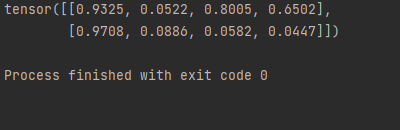

同样我们用torch.rand()生成一个二维张量,再次强调,torch.rand()括号里面输入几个数那就是生成几维张量,这里我们输入两个数:

import torch

#生成二维张量

x = torch.rand(2,4)

print(x)

生成了个两行四列的张量(矩阵):

二维张量常见于灰度图像当中,灰度图像即为一个二维张量数据!

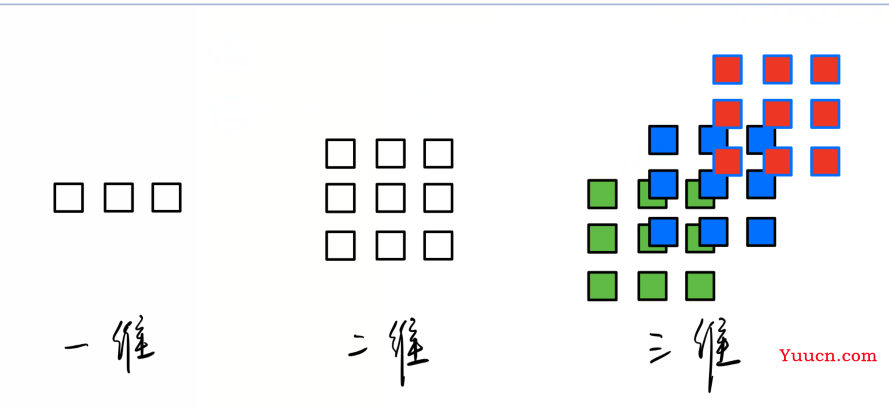

理解第三步(三维张量):

理解三维张量也相对容易,二维张量可以看作一个平面,而三维张量就可以看作很多个二维张量平面两两平行摆放。

例如我们常见的RGB图像就可以理解为3个二维灰度图像并排摆放。

同样,我们用torch.rand()生成三维张量:

import torch

#rand括号里输入几个数就是生成几维张量

#这里的(2,3,4)分别为(channel,height,width)

x = torch.rand(2,3,4)

print(x)

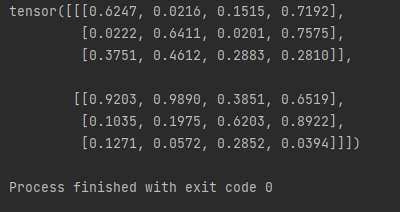

张量结果:

这里通俗理解为,生成了2个平行摆放的3行4列的二维张量!

理解第四步(高维张量):

相信大多数人的想象力就到上面为止了,我们的张量其实不但有3维,还有33维、333维、333333维。。。

在理解高维张量之前,我先想到了俄罗斯套娃,哈哈……:

其实高维张量就可以理解为俄罗斯套娃,单位为“套”

一“套”张量 = 一维张量

n’‘套’'张量 = n维张量

其实张量有专属的高维张量单位,那就是batch,相信跑过深度的同学都知道,训练网络之前都得调batchsize大小,其实本质上就是调的张量维度,维度高了计算机也会吃不消,毕竟理论上可以将batchsize调成9999999哈哈。

同样我们可以通过torch.rand()生成高维张量:

import torch

'''这里的rand()括号里面的参数从第四维开始其实就是不断加入一个新的参数---batch!

例如我这里4维张量就是(batch,channel,heigth,width)

那如果是6维张量那就是(batch,batch,batch,channel,heigth,width)

不断地在前面加batch就好啦!'''

x = torch.rand(2,3,4,5)

print(x)

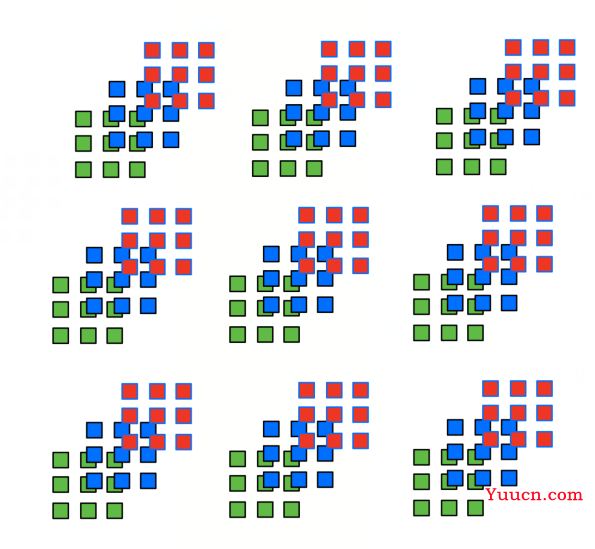

输出结果:

用我们俄罗斯套娃的话术将就是:我们生成了个2套3层4行5列的四维张量!

当然我们还可以生成5套6套7套8套9层10行11列的张量哈哈,即:torch.rand(5,6,7,8,9,10,11)

当然,我们还可以通过简图通俗理解以及想象高维张量长啥样!

例如:

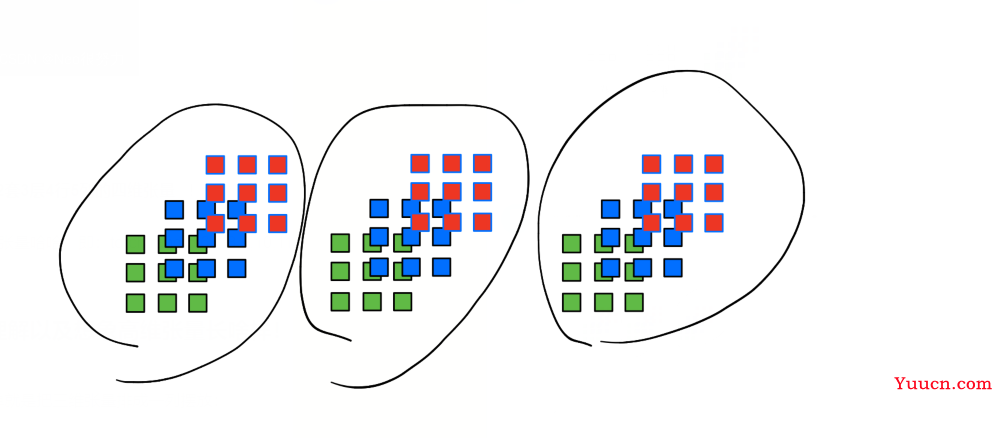

三维张量为一套(1个batch),那么四维张量很简单就是把三维张量排成一列摆放:

好啦,三套张量排排放!这就是我们的四维张量啦!

那五维张量长啥样呢?我们来看看:

这就是五维张量啦,也就是3套四维张量并排放!

其实在这我们就可以看到张量的升维其实也是在降维!

怎么理解呢,其实不知道大家有没发现上面2张图的过程很像我们第三步的那张图,我们的三维张量在上图五维张量中就可以看作为当初最基础的单位:那个小方格。

同样如果是六维张量就是把五维张量这个“平面”平行叠多层即是升维。

其实batch不断地充当最初的那个小方格了,只不过是大套包小套,小套变小格!(bigger batch includes smaller batch, and smaller batch changes into little grid )

诶,人生无常,大肠包小肠,不知道你是否从这通俗的解释中彻底明白了张量tensor呢哈哈……